こんにちは。サービスかんきちです。

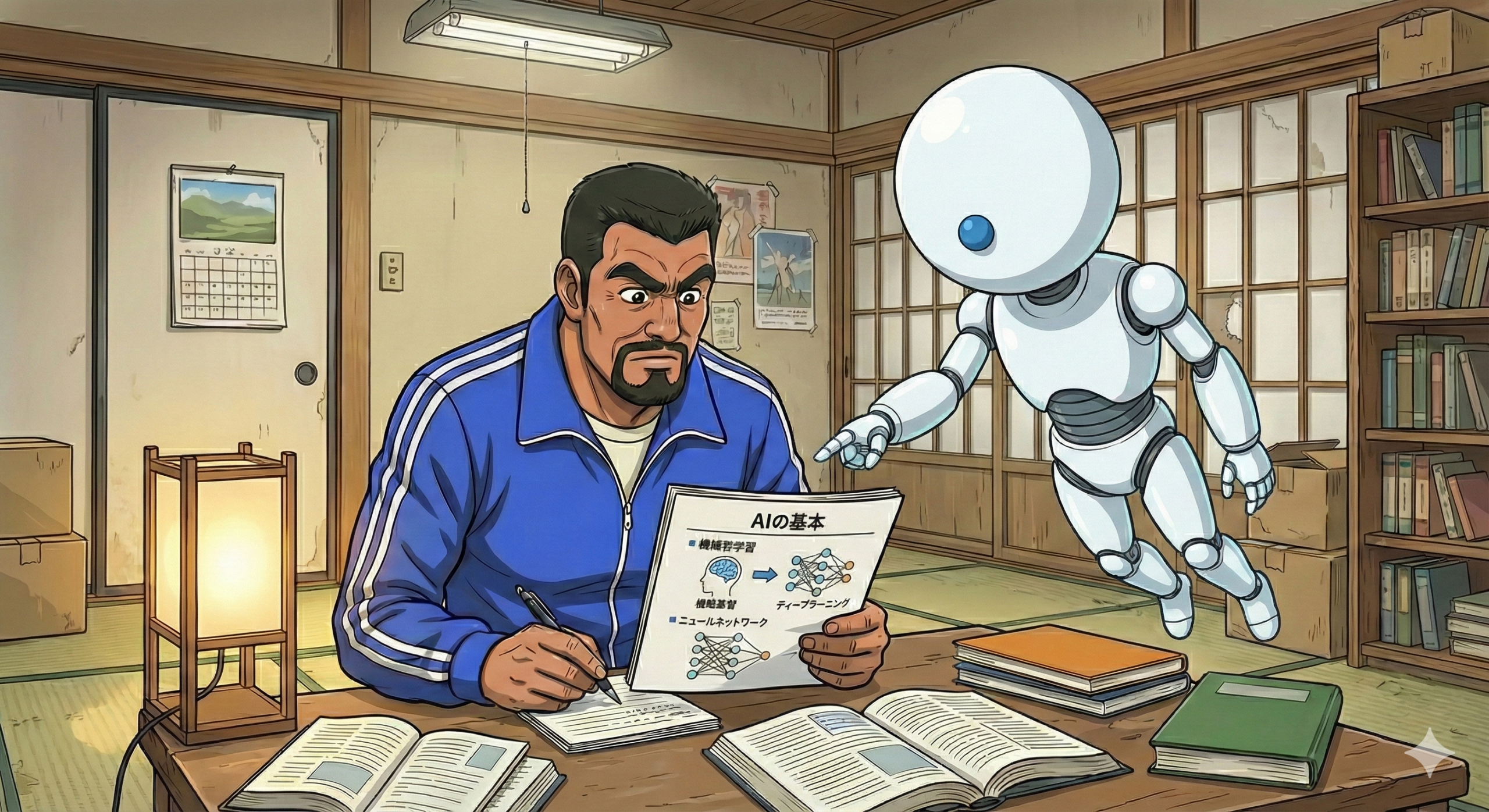

「AIリーダー」への道を歩み始めた私ですが、まず最初にやるべきこととして、私の方からAI家庭教師にこうリクエストしました。

かんきち

かんきちすぐにツールの使い方を覚える前に、まずは「AIの歴史と仕組み」を教えてください。

AIがエラーを出したり嘘をついた時に、仕組みを知らないと冷静に対応できない気がするからです。

「急がば回れ」。この判断は大正解でした。

今回は、私がAI先生に素朴な疑問をぶつけまくり、納得するまで食い下がった「AIの基礎講義」の一部始終を公開します。

- AIの正体を知れば、エラーも冷静に対処できる。

- 「RAG」を使えば、AIにマニュアルをカンニングさせられる。

- AIに丸投げせず、指揮者として使いこなすのが私たちの未来。

「レセプトソフト」と「今のAI」は何が違う?

授業の冒頭、AI先生から衝撃の事実を教わりました。

「昔のAI(第2次AIブーム)」の代表例は、私たちが普段使っている「レセプトソフト(請求ソフト)」だと言うのです。

えっ? レセプトソフトってAIなんですか?

でも、レセプトソフトは計算間違いをしませんよね。今のAIはもっともらしい顔で嘘をつくのに…。

もしかして、AIって退化してるんですか?

いいえ、退化ではありません。

作り方が根本的に違うのです。

キーワードは「記号(ルール)」と「確率(パターン)」です。

医療機関や福祉事業所が、国や自治体(国保連)に対して「報酬(お金)」を請求するために使う専用ソフトのこと(レセコンとも呼ばれます)。

「行動援護を1時間行ったら○単位」といった厳格なルールに基づいて計算するため、計算ミスや気まぐれな回答は絶対に起こりません。

昔のAI(記号主義)は、人間が「IF(もし)~THEN(ならば)」というルールを全て手書きでプログラムしていました。

例えば、「もし『行動援護』という記号が来たら、『単価』という記号と掛け算せよ」といった具合です。

ちょっ、ちょっと待ってください!

「記号」っていう表現がいまいち理解しにくいです。

「行動援護」とか「1時間」という文字には意味があるのに、なぜ「記号」と呼ぶんですか?

鋭い質問ですね。

それはコンピューターにとって、それが「中身のない、ただのラベル」に過ぎないからです。

スーパーのレジを想像してください。

レジは「キャベツ」のバーコードを読んで「200円」と表示しますが、それが「緑色でシャキシャキした野菜」だとは理解していませんよね?

ただ「このバーコード(記号)が来たら200と出す」というルールに従っているだけ。だから「記号」なんです。

なるほど…!

レセプトソフトも、「行動援護」がどんなに大変な支援かは理解しておらず、ただの記号としてパズルのように処理しているだけ。だから計算ミスはしないけれど、融通も利かないわけです。

なぜ「昔のやり方」ではダメだったのか?

正確ならそのままで良さそうなものですが、なぜAIは「今の形(機械学習)」に進化したのでしょうか。

昔のやり方(ルールベース)が限界を迎えたのはなぜですか?

詳しく教えてください。

一言で言うと、「現実世界は、人間が手書きできるほど単純なルールの集まりではなかったから」です。

例えば、現場のアセスメントで「利用者がなんとなく不機嫌である」という状況。

これをルール化できますか?

確かに…。「眉間のシワが何ミリで、声のトーンが何Hzで…」なんて無限に定義しなきゃいけなくなります。

この「数値化できない曖昧な文脈」を扱うために、AI自身に大量のデータからパターンを見つけさせる「機械学習」が必要になったのです。

今のAIの弱点と、それを補う「RAG」

しかし、ここで新たな疑問が湧きました。

-150x150.png)

-150x150.png)

-150x150.png)

今のAIは「確率(なんとなくこれっぽい)」で動いているから、嘘をつくことがあるんですよね?

それなら、計算やルールが決まっている業務は、昔のやり方(ソフト)の方が良かったりしませんか?

それともAIは全部カバーできるんですか?

大正解です。素晴らしい着眼点です!

絶対に間違えてはいけない計算(給与計算など)は、今でも昔ながらのソフトに任せるべきです。

しかし、AIにもその弱点をカバーする必殺技があります。

それが「RAG(ラグ)」、つまり「カンニング」です。

AIにあやふやな記憶で答えさせるのではなく、「信頼できるマニュアル(PDFなど)」を渡して、「これを見てから答えて」と指示する仕組みのこと。

さらに私は、この「カンニングの仕組み」について食い下がりました。

そのマニュアルや辞書は、どこに置いておくんですか?

現実の本棚があるわけじゃないですよね?

Google Geminiを使う場合、どこに存在するんですか?

いい質問です!

例えば、「Dify(ディファイ)」というツールを使う場合、システムの中に「ナレッジ」という専用の保管庫があります。

一方、Google Gemini単体の場合は、「Googleドライブ」や「Gems」がその役割を果たします。

じゃあ、「監査用資料」とかフォルダを作っておいて、必要に応じて私が取り出してAIに投げるってこと?

それとも、AIが勝手に中身を覗きに行ってくれるの?

正解は後者です。

「AIが勝手に覗きに行ってくれます」。

あなたが「監査について教えて」と聞くだけで、AIは膨大な資料の中から必要なページを瞬時に見つけ出し(ベクトル検索)、それを読んで回答してくれます。

これには鳥肌が立ちました。

つまり、「とりあえずマニュアルを全部AIに放り込んでおけば、あとはAIが必要な時につまみ食いしてくれる」ということです。これは最強の時短になりそうです。

サビ管の未来は「AIオーケストレーター」

最後に、AI先生から「福祉業界の前例にとらわれず、他業界からヒントを盗め」とアドバイスがありました。

最後に、AI先生から「福祉業界の前例にとらわれず、他業界からヒントを盗め」とアドバイスがありました。

「小売・EC(ネット通販)」のコンシェルジュAIがヒントになります。

「結婚式に行きたい」という漠然とした要望から、「このスーツと靴」を提案するように、

利用者さんの「働きたい」という夢を、「月曜は就労移行、火曜は家事訓練」という具体的な「週間計画」に変換するシステムが作れます。

夢があって素晴らしい話ですが、同時に少し不安も感じました。

-150x150.png)

-150x150.png)

-150x150.png)

確かにそうですが…ひとりひとり育ってきた環境も性格も唯一無二です。

その緻密な分析を、AIが本当に担えるのか不安もあります。

その不安はサビ管として最も大切な感覚です。

だからこそ、「AIオーケストレーター(指揮者)」になる必要があるのです。

AIはデータ分析や論理チェックはできますが、心はありません。

AIが出した提案を見て、「データではそうだが、ご本人の気持ちを優先してこうしよう」と決断し、魂を吹き込むのは、人間にしかできない仕事です。

いかがでしたか?

かなり頭を使いましたが、AIの「中身」を知ることで、得体の知れない怖さが消え、相棒としての信頼感が増した気がします。

次回は、学習カリキュラムの続き「AI学習 第2部」に進む予定です。

コメント